Werbung

Bereits im letzten Sommer hat Tesla über ein Dojo getauftes System gesprochen, bzw. angekündigt, dass es ein solches gibt. Bei Dojo soll es sich um ein Trainingssystem handeln, welches die Daten der inzwischen einer Million Fahrzeuge sammelt und analysiert. Das (teil)autonome Fahren muss an zwei Seiten entwickelt werden, um am Ende ein wirklich eigenständig arbeitendes Fahrzeug zu haben.

Auf Seiten der Tesla-Autos setzt das Unternehmen seit 2019 auf den eigenen FSD-Chip (Full Self-Driving). Details dazu haben wir im nächsten Abschnitt. Die zweite wichtige Komponente ist ein Trainingssystem – also ein Supercomputer, der ein neuronales Netzwerk trainiert, auf dessen Basis die Fahrzeuge zusammen mit den Sensordaten dann selbstständige Entscheidungen vornehmen sollen.

Datenschutzhinweis für Twitter

An dieser Stelle möchten wir Ihnen einen Twitter Feed zeigen. Ihre Daten zu schützen, liegt uns aber am Herzen: Twitter setzt durch das Einbinden des Applets Cookies auf ihrem Rechner, mit welchen sie eventuell getracked werden können. Wenn Sie dies zulassen möchten, klicken Sie einfach auf diesen Feed. Der Inhalt wird anschließend geladen und Ihnen angezeigt.Ihr Hardwareluxx-Team

Tweets ab jetzt direkt anzeigen

Bisher unbekannt ist, welche Hardware Tesla für das Dojo-System verwendet. Im Rahmen des Trainings spricht Tesla nur von 70.000 GPU-Stunden, die aufgewendet wurden, um 48 neuronale Netzwerke zu trainieren, was in 1.000 distinkt formulierten Vorhersagen mündet. Diese 70.000 GPU-Stunden sind jedoch schwer greifbar, da unklar ist, wie viele GPUs gleichzeitig gearbeitet haben und von welcher Leistungsklasse wir hier sprechen. Zu den technischen Details ist weiterhin nicht bekannt, man will aber "später" darüber sprechen.

In diesem Zuge sucht Tesla händeringend nach Chip-Ingeneuren, die in Palo Alto und Austin arbeiten sollen. Auf den aktuellen FSD-Chip sollen sicherlich noch weitere Generationen folgen.

Der FSD-Chip im Detail

Teslas aktuelle FSD-Lösung besteht aus zwei FSD-Chips auf einer Platine, die gleichzeitig arbeiten und auch immer auf die gleichen Ergebnisse kommen sollen. Sie arbeiten also redundant – ermittelt ein System ein anderes Ergebnis, sind die Ausgaben nicht eindeutig und es liegt ein Fehler vor bzw. der Fahrer muss eingreifen.

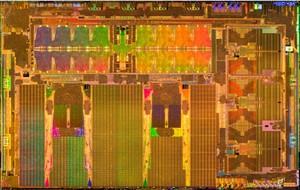

Der FSD-Chip besteht aus sechs Milliarden Transistoren und wird in zwölf Layern bei Samsung in 14 nm gefertigt. Die Chipfläche beträgt 260 mm². Die Thermal Design Power eines Chips liegt bei 36 W – mal zwei genommen kommt ein FSD-System auf eine Leistungsaufnahme von 72 W. Zum Vergleich: NVIDIAs DRIVE-AGX-Orin-Plattform kommt auf bis zu 750 W, soll dann aber auch 2.000 TOPS erreichen. Der FSD-Chip kommt auf 74,33 TOPS, redundant gesehen also etwa 148 TOPS. So einfach lassen sich die Systeme aber nicht vergleichen.

Als Prozessor besteht der FSD-Chip aus drei Quad-Core-Komplexen mit Cortex-A72-Kernen – also insgesamt zwölf dieser Kerne. Die Kerne erreichen einen Takt von 2,2 GHz. Hinzu kommen zwei NPUs (Neural Processing Unit), die 96 x 96 Multiply-Accumulate oder Multiply-Adds durchführen können. Sie liefern mit 73,73 TOPS den Löwenanteil der zur Verfügung stehenden Rechenleistung. Die NPUs besitzen je 32 MB an SRAM. An externem Speicher kommen 8 GB an LPDDR4-4266 zum Einsatz, die über ein 128 Bit breites Speicherinterface angebunden sind und eine Speicherbandbreite von 63,58 GB/s erreichen.

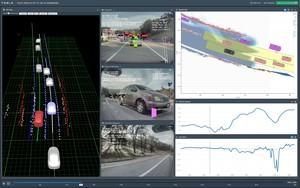

Der FSD-Chip ist darauf ausgelegt, Sensordaten schnellstmöglich zu verarbeiten. Dies bedeutet, dass Video- und Radardaten verarbeitet und mit dem neuronalen Netzwerk abgeglichen werden müssen. Milliarden von Pixeln werden pro Sekunde analysiert und geringe Latenzen verkürzen die Reaktionsszeit bzw. machen ein autonomes Fahren überhaupt erst möglich.