Werbung

Deep-Learning, Machine-Learning und Artificial Intelligence begleiten uns bereits seit einiger Zeit und werden aus dem Alltag auch nicht mehr verschwinden, sondern eher immer stärker in diesen eingreifen und Bestandteil dessen werden. Eine der wichtigsten Bibliotheken in diesem Bereich ist Caffe. Facebook hat auf der F8-Konferenz angekündigt, dass man den Nachfolger Caffe2 entwickelt hat.

Dieser soll auch als Open-Source-Projekt veröffentlichen werden.

Facebook arbeitet im Deep-Learning-Bereich schon länger mit NVIDIA zusammen und setzt auch auf Hardware aus dem Hause NVIDIA – darunter auf DGX-1-Server mit jeweils acht Tesla P100. Nicht weiter verwunderlich ist dann natürlich, dass Facebook und NVIDIA bei der Entwicklung von Caffe2 zusammengearbeitet haben.

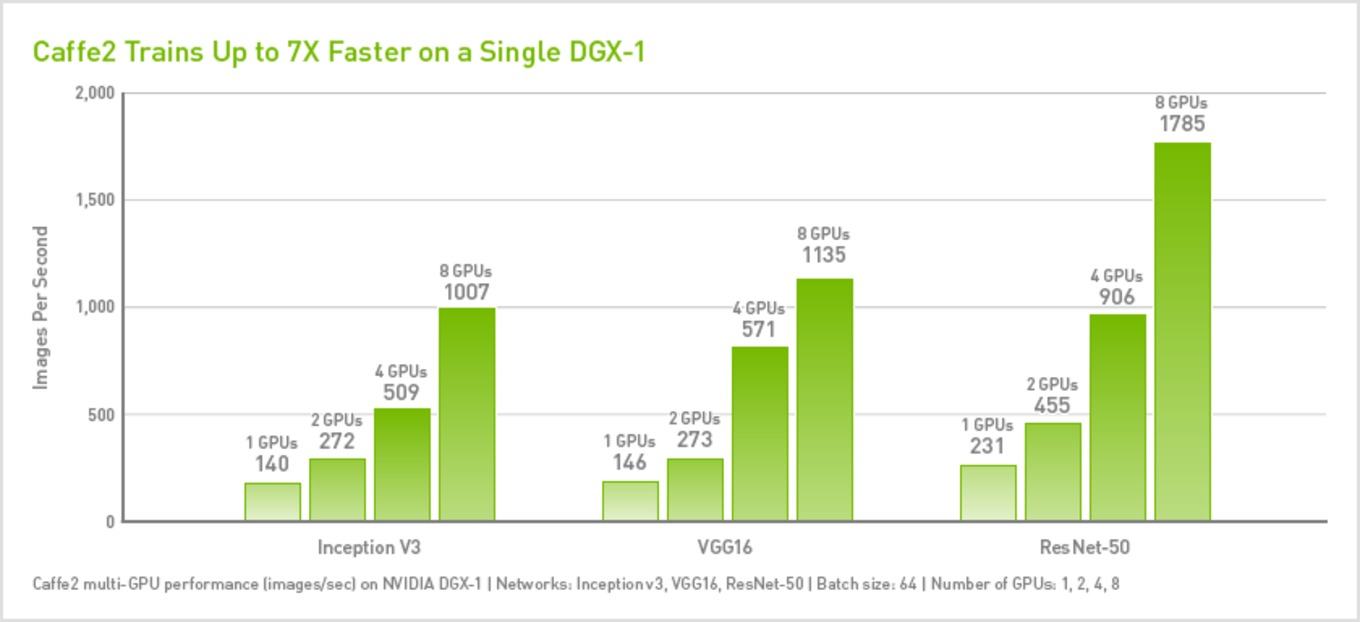

Facebook verwendet aber auch eigene Hardware, unter anderem die Big Basin AI Server, die 64 Tesla P100 verwenden. Caffe2 soll dabei nahezu linear mit der Anzahl der GPUs bzw. Kerne skalieren – NVIDIA spricht vom Faktor 57 bei 64 Tesla P100.

Caffe2 nutzt die meistgenutzten Deep-Learning-SDK-Bibliotheken wie cuDNN, cuBLAS und NCCL. Wie in diesem Bereich üblich, ist Caffe2 auf das Training und Inferencing auf mehreren GPUs hin optimiert. Zwar ist bereits eine NVIDIA Titan Xp dazu in der Lage, ein Deep-Learning-Netzwerk bestimmter Größe zu trainieren, dass ein DGX-1 aber bereits acht Tesla P100 verwendet, zeigt die Optimierung auf mehr als einer GPU. Für das Inferencing sieht NVIDIA die Tesla P4 oder P40 vor.

Im Rahmen der Zusammenarbeit der beiden Unternehmen, beziehungsweise der Optimierung des Software-Stacks für Deep Learning wird der DGX-1 von NVIDIA das erste KI-System sein, das Caffe2 anbietet. Caffe2 für DGX-1 steht Kunden über das DGX-1 Container-Register zur Verfügung.