Werbung

Die Google-Übersetzungen kommen bei einigen Nutzern sicherlich täglich zum Einsatz, andere sind wiederum nur hin und wieder darauf angewiesen. In den vergangenen Jahren haben diese maschinellen Übersetzungen aber große Sprünge in ihrer Qualität gemacht. Vor einigen Wochen stellte Google seine Technik zur Übersetzung auf ein neues Verfahren namens Google Neural Machine Translation system (GNMT) um.

Vor zehn Jahren stellte Google die erste maschinelle Übersetzung vor, die auf Recurrent Neural Networks (RNNs) basierte. Dabei wurden die Wörter einfach 1:1 von einer Sprache in die andere übersetzt. Die Ergebnisse waren dementsprechend von unterschiedlicher Qualität und extrem davon abhängig, welcher Inhalt übersetzt werden soll und von welcher Sprache in eine andere übersetzt werden sollte. Eine erste Verbesserung wurde mit der Phrase-Based Machine Translation (PBMT) erreicht. Dabei wird der Input in einzelne Wörter und Phrasen aufgeteilt. Es gewisser Weise findet damit eine inhaltliche Bewertung statt und dementsprechend erfolgt auch die Übersetzung. Die PBMT stellte eine deutliche Verbesserung dar, kann aber noch immer nicht in allen Fällen überzeugen und eignet sich allenfalls für ein inhaltliches Verständnis der Übersetzung.

Seit zwei Jahren arbeitet Google an der Neural Machine Translation (NMT). Dabei wird keine Aufteilung des Inputs mehr vorgenommen, sondern der Input wird als Ganzes verarbeitet. Die NMT war vom Start weg auf Niveau der PBMT, hatte aber deutliches Potenzial zur Verbesserung vorzuweisen, da der Algorithmus über ein Machine Learning bzw. Deep-Learning-Netzwerke trainiert werden kann. Da die NMT aber noch etwas zu langsam war, verzichtet Google auf den produktiven Einsatz – bis vor einigen Wochen.

Als besonders schwierig zeigt sich die Übersetzung in und aus dem chinesischen. Dabei spielt es kaum eine Rolle welche Zweite Sprache verwendet wird. Grund hierfür ist, dass die PBMT kein geeignetes Verfahren zur Übersetzung ist, da sich die chinesische Sprache bzw. die Zeichen nicht 1:1 in Wörter und Phrasen übersetzen lassen. Die NMT geht etwas anders an die Übersetzung und weiß jedem Zeichen einen Vektor mir einer Gewichtung zu. Ein Decoder beginnt dann damit die einzelnen Zeichen zu übersetzen, schaut sich im Verlaufe der Übersetzung aber immer wieder an, ob die Übersetzung zum vorherigen Inhalt passt.

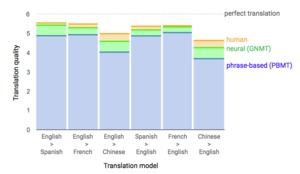

Hinsichtlich der Qualität der Übersetzung kann die NMT die wenigen Prozente beisteuern, die dafür sorgen, dass die Übersetzung natürlich klingt. Die PBMT konnte gerade im Falle einer Übersetzung in und aus dem Chinesischen für eine Fehlerquote von 55 bis 85 % sorgen. Mit Hilfe der NMT wird diese Fehlerquote deutlich reduziert. Natürlich reicht eine maschinelle Übersetzung noch lange nicht an eine menschliche heran, das Niveau wird mit Hilfe der NMT aber deutlich angehoben.

Google setzt die NMT nun in 100 % aller Übersetzungen vom englischen in das chinesische ein. Von diesen Übersetzungen werden 18 Millionen täglich durchgeführt. Schritt für Schritt sollen auch weitere Übersetzungspaare auf das neue Verfahren umgestellt werden. Bei 10.000 Möglichkeiten der Kombination aus verschiedenen Sprachen wird man sich aber zunächst auf die wichtigsten Paare konzentrieren. Letztendlich aber sollen alle Kombinationen auf das neuen Verfahren umgestellt werden. Als Hardware kommt dabei die bereits eingesetzte Tensor Processing Unit (TPU) zum Einsatz. Dabei handelt es sich um einen Custom-ASIC (Application Specific Integrated Circuit), der speziell auf das Machine Learning mittels TensorFlow zugeschnitten ist. Diese kommt bereits bei Deep-Learning-Netzwerken von DeepMind zum Einsatz, die z.B. in Go bereits die menschlichen Gegner besiegt haben. Als nächstes möchte Google in diesem Bereich auch in Starcraft II auf sich aufmerksam machen.