Werbung

NVIDIA gibt zu International Supercomuting Conference bekannt, dass man künftig auch den Einsatz der GPU-Beschleuniger in ARM-Servern ermöglichen wird. Damit öffnet sich NVIDIA zunächst einmal nur hinsichtlich der Softwareunterstützung. Zukünftig sind aber auch Systeme mit ARM-Prozessoren und GPU-Beschleunigern von NVIDIA denkbar.

Neuigkeiten im Bereich der GPU-Beschleuniger selbst hat man nicht zu verkünden. Auch eine neue HPC-Architektur hat man nicht vorgestellt. Stattdessen fokussiert man sich derzeit verstärkt auf den Ausbau der Softwareunterstützung. 25 % aller Supercomputer der Top500-Liste sind mit Hardware aus dem Hause NVIDIA bestückt. Die Zahl der Entwickler wächst laut NVIDIA weiterhin deutlich und mit entsprechender Software-Basis bindet man diese auch an die eigene Hardware.

Derzeit verwendet NVIDIA in den eigenen Servern für die Anbindung der GPU-Beschleuniger meist Prozessoren aus dem Hause Intel. Auch Kundenhardware verwendet häufig Intel-Prozessoren und somit werden die GPUs selbst per PCI-Express angebunden. NVLink kommt als Interconnect nur bei Servern mit IBMs Power9-Prozessoren zum Einsatz. Die nun neuen und geplanten Server auf Basis von ARM-Prozessoren werden vermutlich ebenfalls vorerst nur PCI-Express zur Anbindung verwenden. Es ist aber durchaus denkbar, dass zukünftig ARM-Prozessoren auch eine Integration von NVLink erhalten.

"We are excited to work with NVIDIA and server OEMs to couple the CUDA-X platform and NVIDIA GPUs with the Marvell ThunderX2 family of server processors. The combination of ThunderX2’s best-in-class 64-bit Armv8 performance and NVIDIA GPUs offers breakthrough levels of energy efficiency and application performance, enabling world-class HPC and AI solutions for exascale computing." – sagt Matt Murphy, CEO von Marvell.

"We have been a pioneer in using NVIDIA GPUs on large-scale supercomputers for the last decade, including Japan’s most powerful ABCI supercomputer. At Riken R-CCS, we are currently developing the next-generation, Arm-based, exascale Fugaku supercomputer and are thrilled to hear that NVIDIA’s GPU acceleration platform will soon be available for Arm-based systems." – sagt Satoshi Matsuoka, Direktor des Riken Center for Computational Sciences (R-CCS).

Gegen Ende 2019 sollen die ersten Systeme in Kombination zwischen ARM-Prozessoren und NVIDIA GPU-Beschleuniger erhältlich sein.

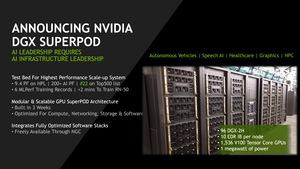

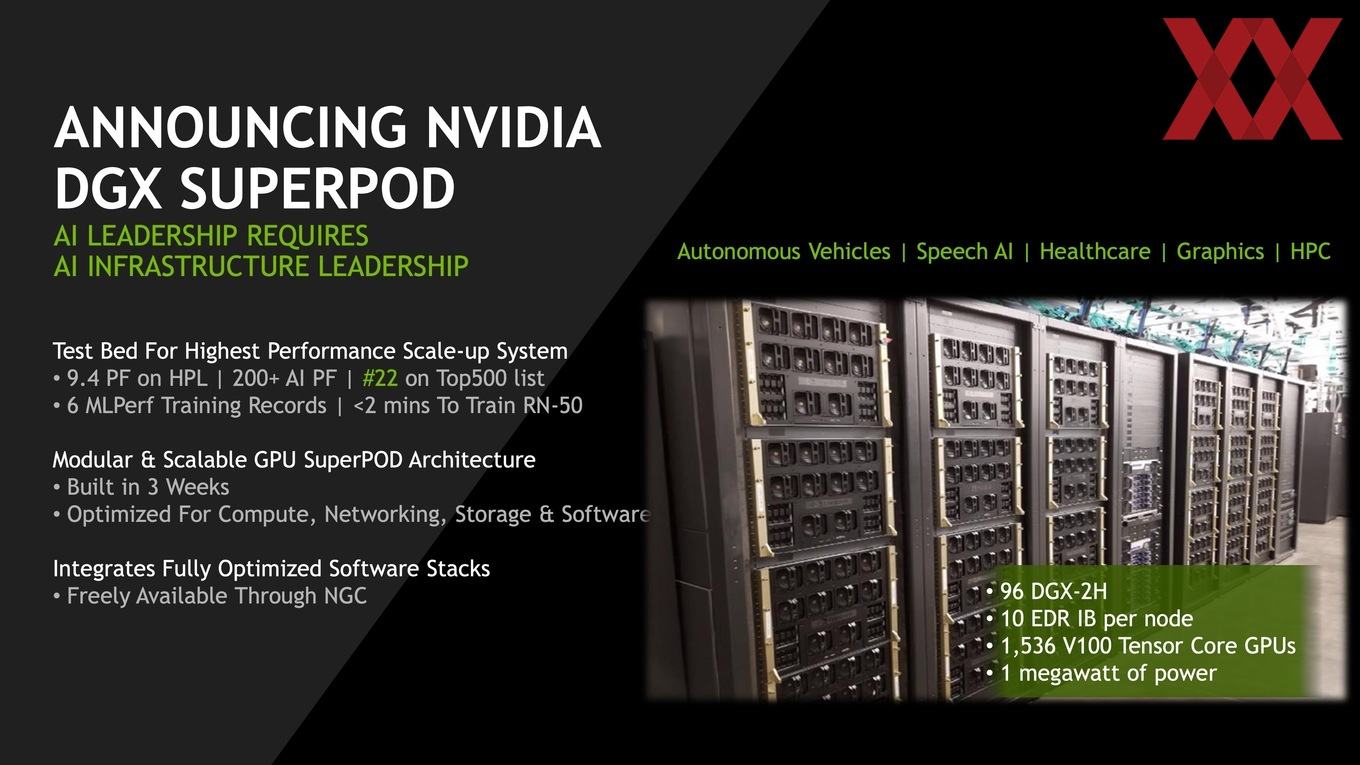

DGX Superpod als neues Referenzsystem

Außerdem gibt NVIDIA bekannt, dass man mit dem DGX Superpod ein neues Referenzsystem für HPC-Server entwickelt hat. Ein Superpod besteht aus 96 DGX-H2, verwendet 1.536 Tesla V100, einen 10 EDR InfiniBand pro Node und verbraucht 1 MW an Leistung.

Die Rechenleistung gibt NVIDIA mit 9,4 PFLOPS an. Die AI-Leistung liegt bei 200 POPS (Peta Operations pro Sekunde). Ein solches System landet bereits auf Platz 22 der Top500-Liste.

Die aktuelle Liste der Top500-Supercomputer führt die Systeme nach ihrer Leistung im High Performance Linpack (HPL) auf. NVIDIA nennt bei den eigenen Systemen aber häufig auch die AI- bzw. ML-Leistung. Aufgrund der geringeren Genauigkeit (FP16 oder INT8) werden hier deutlich mehr Operationen pro Sekunde ermöglicht. NVIDIA würde in Zukunft auch gerne eine Rangliste nach dieser Leistungsklasse einführen.