Werbung

Zusammen mit den neuen GeForce-RTX-Grafikkarten hat NVIDIA auch eine neue Technik namens Deep Learning Super Sampling (DLSS) vorgestellt. In der derzeitigen Umsetzung haben wir uns DLSS im Test der Founders Editions der GeForce RTX 2080 Ti und GeForce RTX 2080 bereits angeschaut. Dazu stellte NVIDIA eine spezielle Version des Final-Fantasy-XV-Benchmark zur Verfügung. Eben diese Stand bisher nur der Presse zur Verfügung, wurde nun aber für die Allgemeinheit veröffentlicht.

NVIDIA kündigt die Veröffentlichung des Final Fantasy XV Benchmark mit DLSS auf der eigenen Seite an. Die Entwickler von Final Fantasy XV haben erst kürzlich angekündigt, keine Erweiterungen mehr für das Spiel zu entwickeln. Damit ist es auch unwahrscheinlich geworden, dass es DLSS und oder die RTX-Effekte in das Spiel schaffen werden.

Wer die Tensor Cores seiner GeForce-RTX-Grafikkarte einmal ausprobieren möchte, hat mit dem Final-Fantasy-XV-Benchmark nun zumindest die Möglichkeit dazu – auch wenn wir noch nicht einer Integration in einem finalen Spiel sprechen. Der Download des Final-Fantasy-XV-Benchmark ist direkt bei den Entwicklern möglich.

Battlefield V hat gestern das Update für die DXR-Effekte veröffentlicht und wir haben erste Benchmarks erstellt. Damit gibt es zumindest einen Titel, der die Hardwarebeschleunigung der neuen Karten unterstützt. Weitere sollen folgen.

Datenschutzhinweis für Youtube

An dieser Stelle möchten wir Ihnen ein Youtube-Video zeigen. Ihre Daten zu schützen, liegt uns aber am Herzen: Youtube setzt durch das Einbinden und Abspielen Cookies auf ihrem Rechner, mit welchen Sie eventuell getracked werden können. Wenn Sie dies zulassen möchten, klicken Sie einfach auf den Play-Button. Das Video wird anschließend geladen und danach abgespielt.

Ihr Hardwareluxx-Team

Youtube Videos ab jetzt direkt anzeigen

Hintergrund zu DLSS

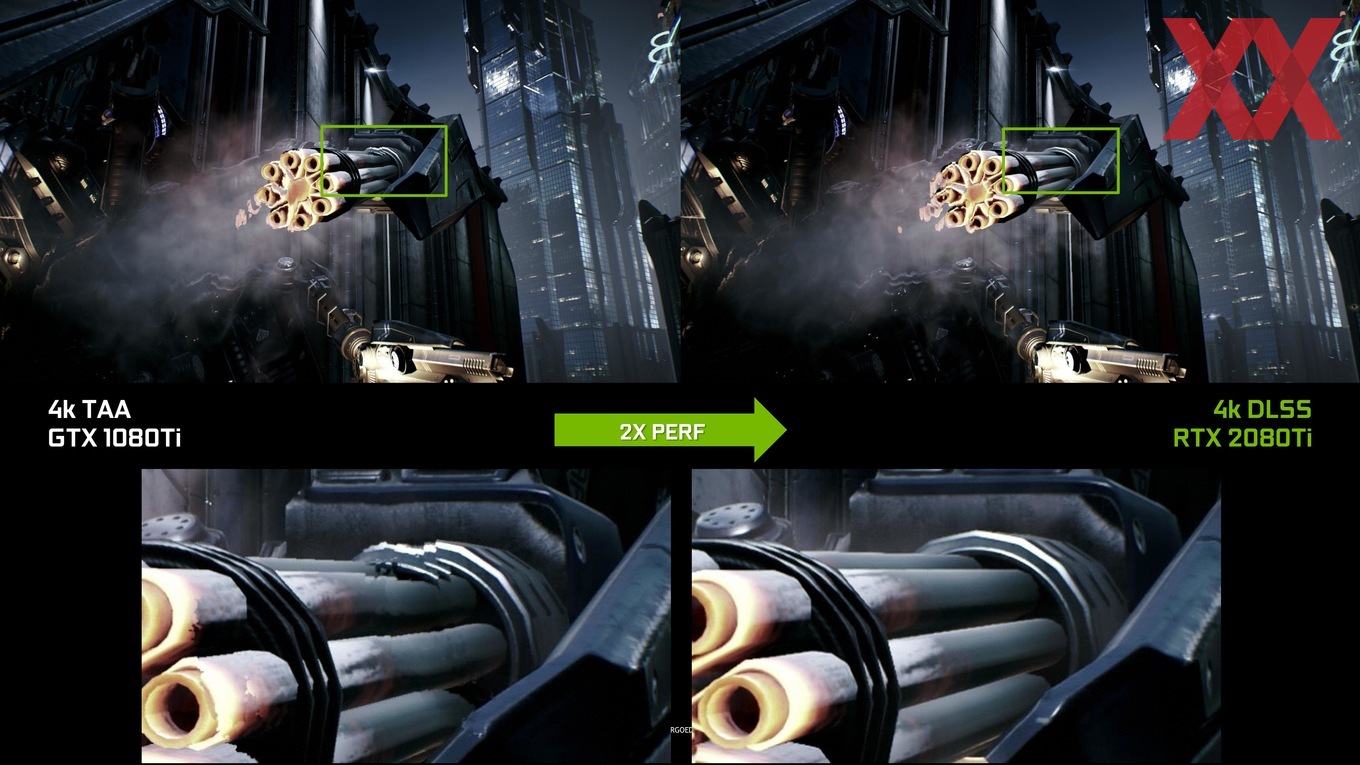

Man kann sich das dazugehörige Deep-Learning-Netzwerk als Black Box vorstellen. Eingangsdaten sind zum einen das von der eigenen Grafikkarte gerenderte Bild (in einer niedrigeren Auflösung als die Zielauflösung) sowie vordefinierte Idealzustände eines gerenderten Bildes. Diese liegen in einem 64x Supersampling (64xAA) vor und wurden auf einem SATURN V getauften Supercomputer bei NVIDIA berechnet. Aus der Differenz des durch die eigene Grafikkarten gerenderten Bildes und dem Idealzustand für die Ausgabe erstellt. Dieses Inferencing findet auf den Tensor Cores statt.

Im Endeffekt ist der DLSS-Algorithmus ein hochspezialisierter (und temporaler) Upsampling-Filter. Das Resultat kann nicht mit einem direkten Rendering auf der nativen Auflösung gleichgesetzt werden, nähert sich diesem abhängig von den Trainingsdaten und den Optimierungen aber stark an. Um auf ein gleiches Ergebnis zu kommen, müssten die Trainingsdaten unendlich groß sein und das Deep-Learning-Netzwerk ebenso unendlich lange trainiert werden. Man wird also im Vergleich zu den Trainingsdaten immer irgendwelche Artefakte und Ungenauigkeiten haben - die Frage ist, ob diese auch sichtbar sind.

Da die Trainingsdaten aber in diesem Falle als 64x Supersampling vorliegen, kann der 2K-Frame mit Upscaling auf 4K besser aussehen als das nativ berechnete 4K-Frame. Das Training ist ein entscheidender Faktor, der am Ende zu einem möglichst guten Ergebnis beiträgt. Je mehr trainiert wird, desto besser wird der Algorithmus.

DLSS 2x wird im zweiten Schritt als Eingangswert einen gerenderten Frame aus der Grafikkarte in der geplanten Ausgabeauflösung hernehmen und über das Inferencing mit den Trainingsdaten abgleichen. Im ersten Schritt und in den aktuellen Tests findet aber immer ein Upscaling statt.