Neurosphere

Enthusiast

Thread Starter

- Mitglied seit

- 06.11.2008

- Beiträge

- 4.324

nVidia GK100/Geforce 6xx [Speku-, News- & Diskussionsthread]

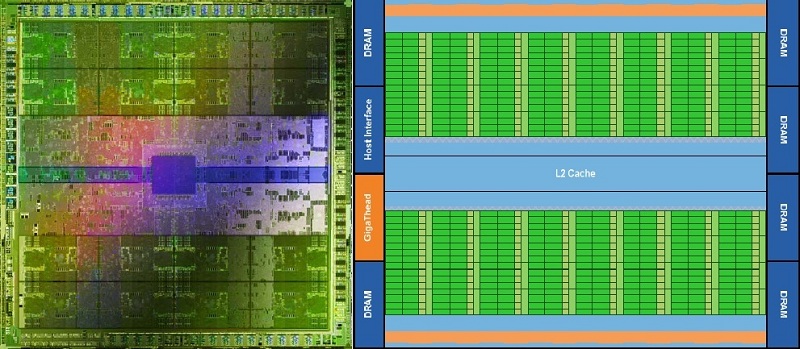

Bild eines GK104 PCB mit Chip

GTX 680 Launch Video:

An dieser Stelle möchten wir Ihnen ein Youtube-Video zeigen. Ihre Daten zu schützen, liegt uns aber am Herzen: Youtube setzt durch das Einbinden und Abspielen Cookies auf ihrem Rechner, mit welchen sie eventuell getracked werden können. Wenn Sie dies zulassen möchten, klicken Sie einfach auf den Play-Button. Das Video wird anschließend geladen und danach abgespielt.

Youtube Videos ab jetzt direkt anzeigen

Bild eines GK104 PCB mit Chip

GTX 680 Launch Video:

Datenschutzhinweis für Youtube

An dieser Stelle möchten wir Ihnen ein Youtube-Video zeigen. Ihre Daten zu schützen, liegt uns aber am Herzen: Youtube setzt durch das Einbinden und Abspielen Cookies auf ihrem Rechner, mit welchen sie eventuell getracked werden können. Wenn Sie dies zulassen möchten, klicken Sie einfach auf den Play-Button. Das Video wird anschließend geladen und danach abgespielt.

Youtube Videos ab jetzt direkt anzeigen

Was ist bisher bekannt:

Die Chips:

Codename: Kepler

Prozess: TSMC 28nm

Chipscode: GK1xx

High End: GK110

Performance: GK104

Entry: GK107/GK106

Änderungen gegenüber der Fermi-Architektur soweit bekannt:

-Keine Hotclocks mehr, diese Veräderung führt zu kleineren Shadereinheiten und somit zu mehr Einheiten pro Chip, was den niedrigeren Takt ausgleicht. Neuere Spekulationen gehen allerdings wieder in eine andere Richtung. So sollen die Hotclocks bleiben und der Chip wie immer breiter werden. Es wäre auch Denkbar das die ALUs ganz überarbeitet werden und neue Funktionen hinzu kommen die ihre Leistung erhöhen. Was davon richtig ist wird man wohl erst einige Wochen vor Launch erfahren.

-> Vorteil: Mehr ALU Leistung schadet nie.

-> Nachteil: Sollte NV einen exotischen Weg bei der Umgestaltung der ALUs gehen könnte es zu Problemen bei der Auslastung kommen.

-NV soll daran arbeiten die Chiptaktraten enorm zu steigern. Dadurch würden die TMUs wesentlich Leistungsfähiger werden da sie direkt an den Chiptakt gekoppelt sind. Target soll bei über 1 GHz liegen.

-> Vorteil: Die reine Spieleleistung steigt. TMUs spielen noch immer eine sehr wichtige Rolle bei Spielen, aufgrund der Entwicklung von GPUs zu HPC-Monstern wurde hier aber des öfteren "gespart".

-> Nachteil: Mehr Takt bedeutet meist immer hoher verbrauch, auch wenn sie von deutlich mehr Effizienz der Gen im Vergleich zu Fermi sprechen (mm²/Watt) muss sich das dann erst bewahrheiten.

-Gerüchten zufolge will NV mehr Features in den neuen Chip integrieren. Möglich scheint verbessertes/erneuertes PhysX und Cuda, aber auch Techniken ähnlich eyefinity von AMD könnte einzug halten.

-> Vorteil: Features sind immer gut. Gerade bei Multimonitoring auf einer Karte hatte NV bisher das nachsehen. PhysX bleibt die beste Physikbibliothek auf dem Markt.

-> Nachteil: Gerade bei PhysX besteht bei der GPU-Berechnung und dessen Unterstützung ziemlicher stillstand. Wenn NV nicht das Problem ihres proprietären Standards lösen kann wird PhysX auf der GPU auch weiterhin ein nischendasein führen.

Die Daten zu den beiden bisher bekannten Chips im Einzelnen:

Vergleichsdaten und Technik der Vorgänger

Innerer Aufbau:

Die GPCs:

Der GF100 besteht aus Graphics Processing Clusters (kurz GPCs). Jeder GPC besteht aus 4 Streaming-Multiprocessors (SM),

in denen jeweils 4 Texture Mapping Units (TMUs) und 32 Arithmetic Logic Units (ALUs) untergebracht sind.

Nach derzeitigen Informationen kann der GF100 maximal 4 GPCs verwalten, womit er auf die besagten 512 "Cuda-Cores" (ALUs) und 64 TMUs kommt.

Besonders beim GF100 ist, das jeder GPC auf eine eigene Raster-Engine zurückgreifen kann. Alle bisherigen Designs und Architekturen hatten nur eine Raster-Engine die vor den Shaderclustern lag. Dadurch erhöht sich die Pixelleistung auf 32 Pixel pro Takt (4 GPCs x 8 Pixel) wodurch ein Flaschenhals aller bisherigen Architekturen beseitigt wurde und die Geometrieleistung überdurchschnittlich steigt. Deutlich zu sehen bekommt man dies an der Tesselationsleistung des GF100, nach NV-eigenen Folien ist diese zwischen 2 bis mehr als 6 mal so hoch wie die der 5870 von ATI.

Nun weiter zu den SM:

Zu jeder ALU gesellt sich eine Floating Point Unit (FPU). Der GF100 ist IEEE 754-2008-Standard kompatibel was ihn für GPGPU Aufgaben interessant macht.

Anders als der GT200 führt der GF100 pro Takt keine MADD+MUL Berechnung mehr aus sondern eine FMA. Das schmälert zwar auf den ersten Blick etwas die Rechenleistung pro ALU, allerdings erreicht FMA eine höhere Genauigkeit bei den Nachkommastellen, was ebenfalls wieder wichtig für GPGPU ist.

Die TMUs:

Auf den ersten Blick hat NV hier weniger verbaut als beim GT200. Allerdings soll die Taktrate nicht über den Chiptakt laufen sondern evtl in Richtung des Shadertaktes gehen, des weiteren soll die Effizienz aufgrund des größeren L1 (12 Kb Texture Cache + 64 Kb L1/Shared-Cache) und L2 Caches (768 Kb) weiter gesteigert worden sein. NV gibt für die TMUs bis zu 1,6 mal soviel Leistung wie beim GT200 an.

Die ROPs:

Die Raster Operation Processors (ROPs) wurden beim GF100 dahingehend überarbeitet, das es nun sechs ROP-Partitions gibt in denen jeweils 8 ROPs enthalten sind. Eine ROP kann nach einem Takt ein 32-Bit-Integer-Pixel, ein 16-Bit-Floating-Point-Pixel nach zwei Takten oder ein 32-Bit-FP-Pixel nach vier Takten ausgeben.

An Jeder ROP-Partition ist ein 64 Bit Speicherinterface angeschlossen womit der GF100 auf ein insgesammt 384bit breites Interface kommt.

Es sei nochmal gesagt das sich dieser Teil auf GF100 bezieht, da Kepler aber wohl eine Weiterentwicklung ist soll er beim Spekulieren helfen!

Links zu News rund um Kepler:

Nvidia bestätigt: Kepler erst 2012

Prognosen zu AMDs Southern Islands und nVidias Kepler | 3DCenter.org

TSMC promises to deliver 28nm chips by year

Nvidia Kepler: Schneller als als Fermi bei geringerer TDP?

TSMC 28nm Fertigung weniger ertragreich uns später als bisher gedacht [pcgh]

Nvidia: We Are Well Prepared for 28nm Process Technology - X-bit labs

Kepler produziert 2011, verkauft 2012? [Computerbase]

Hardwareluxx - NVIDIAs "Kepler" soll noch dieses Jahr vom Band laufen

Nvidia stellt erste Sampels von Kepler her [HWL]

Kepler evtl im Dezember [Digitimes engl.]

Kepler früher als erwartet [Computerbase/Kitguru]

Gerüchte als Artikel verpackt bei 4gamer.net [4gamer.net, translatet englisch]

http://www.hardwareluxx.de/communit...samples-bereit-neue-spekulationen-858299.html

Kepler ohne Hotclocks [3DCenter]

Gesammelte Grafiken

Da immer wieder neue halbwegs glaubwürdige aber als Fakes enttarnte Grafiken die Runde machen sammel ich hier mal was es bisher in den Thread geschafft hat.

Dieser Thread wird von mir aktuell gehalten und sobald handfeste oder glaubbare Infos bekannt werden auf den neusten Stand gebracht.

Ich bitte alle User die an diesem Thread teilnehmen sich an eine gewisse Netiquette zu halten. Bitte lasst den Thread auch nicht zu einem Flamewar Rot gegen Grün verkommen sondern spekuliert aufgrund bekannter Fakten über den GK100. Versucht eigene Meinungen so wenig wie möglich in euren Post einfließen zu lassen, ebenso sind eure Wünsche und Kaufpläne evtl für andere User uninteressant.

Zuletzt bearbeitet:

im 3.Quartal mit der Produktion der 28mm Chips für Kepler beginnen, damit Nvidia dieses Jahr mit der Kepler Produktion beginnen kann. Aber erst für Anfang 2012 sollen die Karten überall erhältlich sein.

im 3.Quartal mit der Produktion der 28mm Chips für Kepler beginnen, damit Nvidia dieses Jahr mit der Kepler Produktion beginnen kann. Aber erst für Anfang 2012 sollen die Karten überall erhältlich sein.