Werbung

MLPerf hat sich zum Ziel gesetzt, eine bessere Vergleichbarkeit für die Bestimmung und den Vergleich von Rechenleistung im AI-, bzw. ML-Bereich herzustellen. Neben den großen Chip-Herstellern Intel und NVIDIA sind auch ARM, Google, Intel, MediaTek, Microsoft und viele anderen Unternehmen daran beteiligt und ermöglichen somit eine bessere Vergleichbarkeit der Leistung in diesem Bereich.

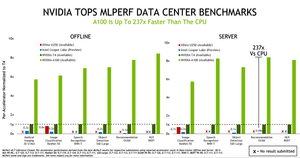

Nachdem bereits vor einiger Zeit die Resultate für MLPerf Training v0.7 veröffentlicht wurden, in denen NVIDIAs neuer A100 die Führungsrolle übernommen hatte, sind nun die Ergebnisse für das MLPerf Inference v0.7 online. Darin wird nicht das Training mit hoher Genauigkeit betrachtet, sondern die Leistung für das Inferencing, bei dem eine geringere Genauigkeit und ein hoher Durchsatz gefordert sind.

Die Vergleichssysteme beschränken sich also auf solche, die mit NVIDIAs T4 und A100 bestückt sind, sowie auf solche mit Xilinx-FPGA und Intels Cooper-Lake-Xeons haben einen Beitrag geleistet.

Wenn man nun die Ergebnisse miteinander vergleicht, muss man natürlich darauf achten, dass hier Systeme mit zwei, vier, acht und mehr GPU-Beschleunigern mit Systemen mit nur einem FPGA oder ebenfalls zwei, vier oder acht Prozessoren verglichen werden. Man sollte also einen gewissen Skalierungsfaktor im Hinterkopf behalten. Außerdem sind die Ergebnisse nicht über alle Anwendungen gleich. Je nach Software und Schnittstellen profitiert mal die eine und mal die andere Plattform.

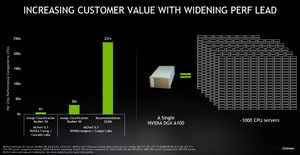

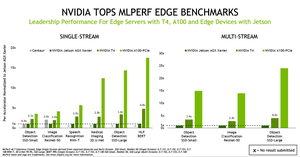

Man kann allerdings festhalten, dass ein A100-GPU-Beschleuniger mehr als 200 Mal schneller sein kann, als ein Xeon-Prozessor auf Basis von Cooper Lake. Selbst die kleinere T4, welche explizit auf das Inferencing ausgelegt ist, ist teilweise um den Faktor 30 schneller. NVIDIA liegt mit seinen AI-Lösungen (A100, T4 und auch Jetson AGX Xavier) in 85 % aller Benchmarks vorne.

Datenschutzhinweis für Twitter

An dieser Stelle möchten wir Ihnen einen Twitter Feed zeigen. Ihre Daten zu schützen, liegt uns aber am Herzen: Twitter setzt durch das Einbinden des Applets Cookies auf ihrem Rechner, mit welchen sie eventuell getracked werden können. Wenn Sie dies zulassen möchten, klicken Sie einfach auf diesen Feed. Der Inhalt wird anschließend geladen und Ihnen angezeigt.Ihr Hardwareluxx-Team

Tweets ab jetzt direkt anzeigen

Natürlich nutzt NVIDIA die MLPerf-Plattform um Werbung in eigener Sache zu machen. Man ist einer der größten Mitgestalter und liefert mit am meisten Ergebnisse. AMD nimmt gar nicht daran teil und kann daher auch nicht auftauchen. Da NVIDIA 85 % der Benchmarks für sich entscheidet, präsentiert man die Ergebnisse natürlich sehr gerne. Aber auch bei Xilinx weiß man die Ergebnisse zu nutzen, wenngleich man sich hier auf nur wenige Anwendungen und Anwendungsprofile berufen kann.