News und Artikel durchsuchen

{{#data.error.root_cause}}

{{/data.error}}

{{^data.error}}

{{#texts.summary}}

[{{{type}}}] {{{reason}}}

{{/data.error.root_cause}}{{texts.summary}} {{#options.result.rssIcon}} RSS {{/options.result.rssIcon}}

{{/texts.summary}} {{#data.hits.hits}}

{{#_source.featured}}

FEATURED

{{/_source.featured}}

{{#_source.showImage}}

{{#_source.image}}

{{/_source.image}}

{{/_source.showImage}}

{{/data.hits.hits}}

{{{_source.title}}} {{#_source.showPrice}} {{{_source.displayPrice}}} {{/_source.showPrice}}

{{#_source.showLink}} {{/_source.showLink}} {{#_source.showDate}}{{{_source.displayDate}}}

{{/_source.showDate}}{{{_source.description}}}

{{#_source.additionalInfo}}{{#_source.additionalFields}} {{#title}} {{{label}}}: {{{title}}} {{/title}} {{/_source.additionalFields}}

{{/_source.additionalInfo}}

B200

-

MLPerf Inference 5.0: Neue Daten zu B200, TPU v6e sowie Granite Rapids und GB200 & MI325X erstmals dabei

Die MLCommons hat heute die nächste Runde für das Inferencing-Benchmarking und damit einige interessante Datenpunkt für die Leistung der aktuellen KI-Beschleuniger veröffentlicht. Als unabhängige Organisation kann die MLCommons in Zusammenarbeit mit den Herstellern belastbarere Daten liefern, als dies die Hersteller selbst meist tun. In der letzten Runde, MLPerf Inference 4.1, waren die ersten Preview-Ergebnisse zum B200-Beschleuniger von... [mehr]

Die MLCommons hat heute die nächste Runde für das Inferencing-Benchmarking und damit einige interessante Datenpunkt für die Leistung der aktuellen KI-Beschleuniger veröffentlicht. Als unabhängige Organisation kann die MLCommons in Zusammenarbeit mit den Herstellern belastbarere Daten liefern, als dies die Hersteller selbst meist tun. In der letzten Runde, MLPerf Inference 4.1, waren die ersten Preview-Ergebnisse zum B200-Beschleuniger von... [mehr] -

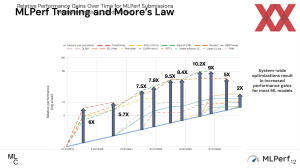

MLPerf Training 4.1: Erstauftritt von NVIDIAs B200 und Googles Trillium im KI-Training

Die MLCommons hat heute die Trainings-Ergebnisse in der aktuellsten Version vorgestellt und diese beinhalten erstmals auch NVIDIAs B200-Beschleungier sowie den Google TPUv6p Trillium. Mit den Inference-4.1-Ergebnissen feierten sowohl der B200 wie auch der TPUv6e ihre Prämiere. An das Inferencing werden aber andere Herausforderungen gestellt, als dies beim Training der Fall ist. Die Blackwell-GPU wurde von NVIDIA zunächst auch primäre mit dem... [mehr]

Die MLCommons hat heute die Trainings-Ergebnisse in der aktuellsten Version vorgestellt und diese beinhalten erstmals auch NVIDIAs B200-Beschleungier sowie den Google TPUv6p Trillium. Mit den Inference-4.1-Ergebnissen feierten sowohl der B200 wie auch der TPUv6e ihre Prämiere. An das Inferencing werden aber andere Herausforderungen gestellt, als dies beim Training der Fall ist. Die Blackwell-GPU wurde von NVIDIA zunächst auch primäre mit dem... [mehr] -

Blackwell-GPU: NVIDIA liefert erste Systeme an OpenAI und Microsoft

2025 will NVIDIA hunderttausende an Blackwell-GPUs ausliefern, deren Fertigung mit etwas Verzögerung aufgrund eines Problems in der Fertigung inzwischen im vollen Gange sein sollten. Inzwischen tauchen mehr und mehr Samples bei den Großkunden von NVIDIA auf. Bereits einer der ersten DGX-Server wurde damals von NVIDIA CEO Jensen Huang persönlich bei OpenAI auf einer Palette geliefert. In alter Tradition ist dies nun wieder der Fall. Das... [mehr]

2025 will NVIDIA hunderttausende an Blackwell-GPUs ausliefern, deren Fertigung mit etwas Verzögerung aufgrund eines Problems in der Fertigung inzwischen im vollen Gange sein sollten. Inzwischen tauchen mehr und mehr Samples bei den Großkunden von NVIDIA auf. Bereits einer der ersten DGX-Server wurde damals von NVIDIA CEO Jensen Huang persönlich bei OpenAI auf einer Palette geliefert. In alter Tradition ist dies nun wieder der Fall. Das... [mehr] -

MLPerf Inference 4.1: Erste Benchmarks zu Granite Rapids, B200, TPU v6e, Instinct MI300X und Turin

Die MLCommons hat eine neue Runde an Benchmarks aus dem Inferencing-Bereich veröffentlicht. Die MLCommons sieht sich als unabhängige Organisation, die einen besseren Vergleich von Datacenter-Hardware ermöglichen will. Die Testbedingungen werden vorgegeben und mit den notwendigen Schranken versehen. Die Teilnehmer testen auf Basis dieser Vorgaben, allerdings können alle weiteren Teilnehmer diese Ergebnisse in einer Review-Phase verifizieren, so... [mehr]

Die MLCommons hat eine neue Runde an Benchmarks aus dem Inferencing-Bereich veröffentlicht. Die MLCommons sieht sich als unabhängige Organisation, die einen besseren Vergleich von Datacenter-Hardware ermöglichen will. Die Testbedingungen werden vorgegeben und mit den notwendigen Schranken versehen. Die Teilnehmer testen auf Basis dieser Vorgaben, allerdings können alle weiteren Teilnehmer diese Ergebnisse in einer Review-Phase verifizieren, so... [mehr] -

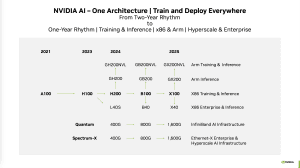

Dell zu NVIDIAs KI-Beschleunigern: B200 und bis zu 1.000 W pro Chip

Im Rahmen der Bekanntgabe der Quartalszahlen (PDF) hat Dells Chief Operating Officer Jeff Clarke einige interessante Aussagen zu zukünftigen KI-Beschleunigern von NVIDIA gemacht. Diese passen ganz gut in das, was NVIDIA höchstselbst Mitte Oktober veröffentlicht hat. Die Kadenz zwischen den einzelnen Beschleuniger-Generationen wird sich erhöhen, teilweise sprechen wir nicht von komplett neuen Chips, sondern beispielsweise von einem Update auf... [mehr]

Im Rahmen der Bekanntgabe der Quartalszahlen (PDF) hat Dells Chief Operating Officer Jeff Clarke einige interessante Aussagen zu zukünftigen KI-Beschleunigern von NVIDIA gemacht. Diese passen ganz gut in das, was NVIDIA höchstselbst Mitte Oktober veröffentlicht hat. Die Kadenz zwischen den einzelnen Beschleuniger-Generationen wird sich erhöhen, teilweise sprechen wir nicht von komplett neuen Chips, sondern beispielsweise von einem Update auf... [mehr]