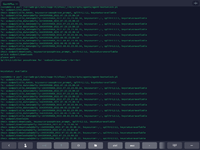

Last login: Tue Aug 23 02:34:19 2022 from 192.168.1.117

OmniOS r151042 omnios-r151042-73702cd512 August 2022

You have new mail.

root@NAS:~# perl /var/web-gui/data/napp-it/zfsos/_lib/scripts/agents/agent-bootunlock.pl

>list enc filesystems

ssdpool/alte_daten, enc_automount:, yes, local

ssdpool/downloads, enc_automount:, yes, local

ssdpool/user30, enc_automount:, yes, local

ssdpool/user30_backup, enc_automount:, yes, local

ssdpool/user30_file_history_backup, enc_automount:, yes, local

ssdpool/user20, enc_automount:, yes, local

ssdpool/user20_file_history_backup, enc_automount:, yes, local

ssdpool/music, enc_automount:, yes, local

ssdpool/projektspeicher, enc_automount:, yes, local

ssdpool/public, enc_automount:, yes, local

ssdpool/user40, enc_automount:, yes, local

ssdpool/user10, enc_automount:, yes, local

ssdpool/vm, enc_automount:, yes, local

process fs with yeautomount yes: ssdpool/alte_daten enc_split: L1:L1 local

check ssdpool/alte_daten, keysource=passphrase,prompt, split=L1:L1, keystatus=available

process fs with yeautomount yes: ssdpool/downloads enc_split: L1:L1 local

check ssdpool/downloads, keysource=passphrase,prompt, split=L1:L1, keystatus=available

process fs with yeautomount yes: ssdpool/user30 enc_split: L1:L1 local

check ssdpool/user30, keysource=passphrase,prompt, split=L1:L1, keystatus=available

process fs with yeautomount yes: ssdpool/user30_backup enc_split: L1:L1 local

check ssdpool/user30_backup, keysource=passphrase,prompt, split=L1:L1, keystatus=unavailable

unlock ssdpool/user30_backup

please wait ...

Split=L1:L1Enter passphrase for 'ssdpool/user30_backup':<br><br>

keystatus: available

process fs with yeautomount yes: ssdpool/user30_file_history_backup enc_split: L1:L1 local

check ssdpool/user30_file_history_backup, keysource=passphrase,prompt, split=L1:L1, keystatus=unavailable

unlock ssdpool/user30_file_history_backup

please wait ...

Split=L1:L1Enter passphrase for 'ssdpool/user30_file_history_backup':<br><br>

keystatus: available

process fs with yeautomount yes: ssdpool/user20 enc_split: L1:L1 local

check ssdpool/user20, keysource=passphrase,prompt, split=L1:L1, keystatus=unavailable

unlock ssdpool/user20

please wait ...

Split=L1:L1Enter passphrase for 'ssdpool/user20':<br><br>

keystatus: available

process fs with yeautomount yes: ssdpool/user20_file_history_backup enc_split: L1:L1 local

check ssdpool/user20_file_history_backup, keysource=passphrase,prompt, split=L1:L1, keystatus=unavailable

unlock ssdpool/user20_file_history_backup

please wait ...

Split=L1:L1Enter passphrase for 'ssdpool/user20_file_history_backup':<br><br>

keystatus: available

process fs with yeautomount yes: ssdpool/music enc_split: L1:L1 local

check ssdpool/music, keysource=passphrase,prompt, split=L1:L1, keystatus=unavailable

unlock ssdpool/music

please wait ...

Split=L1:L1Enter passphrase for 'ssdpool/music':<br><br>

keystatus: available

process fs with yeautomount yes: ssdpool/projektspeicher enc_split: L1:L1 local

check ssdpool/projektspeicher, keysource=passphrase,prompt, split=L1:L1, keystatus=unavailable

unlock ssdpool/projektspeicher

please wait ...

Split=L1:L1Enter passphrase for 'ssdpool/projektspeicher':<br><br>

keystatus: available

process fs with yeautomount yes: ssdpool/public enc_split: L1:L1 local

check ssdpool/public, keysource=passphrase,prompt, split=L1:L1, keystatus=available

process fs with yeautomount yes: ssdpool/user40 enc_split: L1:L1 local

check ssdpool/user40, keysource=passphrase,prompt, split=L1:L1, keystatus=unavailable

unlock ssdpool/user40

please wait ...

Split=L1:L1Enter passphrase for 'ssdpool/user40':<br><br>

keystatus: available

process fs with yeautomount yes: ssdpool/user10 enc_split: L1:L1 local

check ssdpool/user10, keysource=passphrase,prompt, split=L1:L1, keystatus=unavailable

unlock ssdpool/user10

please wait ...

Split=L1:L1Enter passphrase for 'ssdpool/user10':<br><br>

keystatus: available

process fs with yeautomount yes: ssdpool/vm enc_split: L1:L1 local

check ssdpool/vm, keysource=passphrase,prompt, split=L1:L1, keystatus=unavailable

unlock ssdpool/vm

please wait ...

Split=L1:L1cat: cannot open /rpool/keydata/local/keys-part1/ssdpool~vm.kp1: No such file or directory

mess: Keyfile part 1 on L1: no data<br>/rpool/keydata/local/keys-part1/ssdpool~vm.kp1

mess: Keyfile part 2 on L1: no data<br>/rpool/keydata/local/keys-part2/ssdpool~vm.kp2

mess: invalid or missing key

Enter passphrase for 'ssdpool/vm':<br><br>

Key load error: Passphrase too short (min 8).

cannot mount 'ssdpool/vm': encryption key not loaded

error, wrong key

keystatus: unavailable

smb restore fs? ssdpool/alte_daten sharesmb=name=alte_daten

smb restore fs? ssdpool/downloads sharesmb=name=downloads

smb restore fs? ssdpool/user30 name=user30

smb restore fs? ssdpool/user30_backup sharesmb=name=user30_backup

smb restore fs? ssdpool/user30_file_history_backup name=user30_file_history_backup$

smb restore fs? ssdpool/user20 name=user20

smb restore fs? ssdpool/user20_file_history_backup name=user20_file_history_backup$

smb restore fs? ssdpool/music sharesmb=name=music

smb restore fs? ssdpool/projektspeicher name=projektspeicher

smb restore fs? ssdpool/public sharesmb=name=public

smb restore fs? ssdpool/user40 name=user40

smb restore fs? ssdpool/user10 name=user10

smb restore fs? ssdpool/vm name=vm

ok

root@NAS:~#