Die Spiele-Programmierer haben langsam verstanden, dass es keinen Sinn macht, alle paar Jahre einen Kern mehr effizient auszulasten, sondern direkt eine Mehrkern-Optimierung zu implementieren. D.h. Spiele werden nicht bei -6- Kernen Schluss machen, sondern ihre Leistung weiter steigern, wenn -8- Kerne im System sind.

Diese angebliche

Mehrkern-Optimierung nennt sich ganz einfach Multithreading. Da wo es sinnvoll sowie rentabel ist/war Last auf mehrere Threads aufzuteilen, wurde meistens auch Multithreading verwendet. Ausnahmen bestätigen die Regel. Ergo haben auch schon ältere Spiele mehrere Threads benutzt und waren

Mehrkern-optimiert. Um dies zu überprüfen, kann man sich mit solchen Programmen, wie u.a. Process Lasso, anzeigen lassen, wie viele Threads ein Spiel erzeugt. Aber nur weil ein Spiel viele Threads benutzt, heißt dies noch lange nicht, dass dieses auch mit vielen Kernen gut skaliert, da nicht alle Threads parallel abgearbeitet werden können, weil eventuelle Abhängigkeiten zwischen Threads bestehen können, und all diese Threads unterschiedlich viel Last erzeugen, sodass manche daher eben mehr Rechenzeit in Anspruch nehmen als andere. Diese unterschiedlichen Rechenzeiten führen zu Szenarien, wo viele kleine Threads bereits nebenbei abgearbeitet wurden, aber aufgrund der Synchronisierung noch auf die Abarbeitung eines großen Threads gewartet werden muss, bevor das Ergebnis auf den Bildschirm produziert werden kann. Auch der Dx11-Overhead spielt hier eine Rolle. Es entsteht also ein Leerlauf => weniger Auslastung auf den Kernen. So ein asynchroner Ton oder nicht beachtete Eingaben würden das Spielerlebnis durchaus trüben.

Diese fehlende Kernskalierung wird dann oft als fehlende oder schlechte

Mehrkern-Optimierung interpretiert, obwohl das Problem eher daran liegt, dass manche Sachen einfach nicht weiter parallelisiert werden können und eine daraus resultierende ungleiche Auslastung der Kerne, da diese Spiele einfach insgesamt nicht so viel CPU-Power benötigen, sodass die Last in den kleinen Threads relativ gering ist. Bei solchen Spielen wie AC Origin, die sehr viel CPU-Power benötigen, fallen diese kleinen Threads einfach viel größer aus, sodass diese eben nicht mehr so schnell nebenbei abgearbeitet werden können und so besser mit mehr CPU-Breite skalieren.

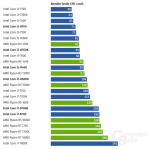

Bestes Beispiel ist "Assassins Creed Origins":

Assassin's Creed Origins: Grafikkarten-Benchmarks, CPU-Leistung

Da ist zwischen -4-, -6- und -8- Kernen ein deutlicher Unterschied zu sehen.

Und so wie die Spiele-Programmierer sich derzeit verhalten, wäre es bescheuert, sich auf eine bestimmte Kernanzahl festzulegen. Heute sind 6-Kerner optimal - in zwei Jahren können sie schon "out" sein. Da hilft dann auch das SMT eines i7 nur begrenzt, siehe 7700K heute.

Genau dies konnte man auch schon bei Ghost Recon Wildlands beobachten:

Aber auch nur weil die CPU untertaktet wurde -> geringere Singlethreadleistung -> Threads werden langsamer abgearbeitet -> mehr CPU-Breite wird benötigt. Aber durch Erhöhung des Taktes, haben schon 4C/4T gereicht, um ins GPU-Limit zu laufen.

Obwohl diese Spiele eine so gute Kernskalierung aufweisen, ist der 7700k immer noch schneller als der 1800x, also wo ist der 7700k bitte am Ende???

Es hieß doch immer

ja aber wenn die Spiele endlichen anfangen mehr Kerne zu nutzen, dann sehen die 4 Kernern mit HTT kein Land mehr und die Ryzen ziehen an denen vorbei. Ja wo denn? Ich sehs immer noch nicht.

Ich persönlich würde also bis zum Frühjahr 2018 warten, was AMD mit "Ryzen Plus" abliefert - ob der Nachfolger des jetzigen R5-1600(X) dann mehr Takt bietet.

Ich hoffe bei Ryzen neben mehr Takt auch auf geringe Latenzen bei der Cross-CCX-Kommunikation.

Aus folgendem Grund:

Bei AMD ist eine Langlebigkeit der Plattform nahezu garantiert. Der "Ryzen Plus" im Frühjahr wird auf AM4 laufen - der Nachfolger "Ryzen 2.0" soll auf AM4 laufen - bis 2019 ist es aber noch ein Stück hin. Das heißt man kauft heute ein Plattform, die man je nach Anforderung weiter und weiter aufrüstet.

Coffeelake läuft auch auf 1151.

Hoffentlich sind die alten Chipsätze mit den neuen Ryzen kompatibel.

Bei Intel ist das alles andere als sicher. Der jetzige 8700K läuft auf dem Z370. In 2018 kommt erstmal der Z390 - der für den 2018/2019 erscheindenen 8-Kerner konzipiert ist, aber auch den 8700K noch aufnehmen soll. Das legt die Vermutung nahe, dass der 8700K auf dem Z370 und Z390 laufen wird - der 9700K (8-Kerner) aber nicht auf dem jetzigen Z370.

Es wurde gemunkelt, dass die Änderungen an der Stromversorgung bei den Z370 Platinen eher für den 8-Kerner relevant sind, als für den 6-Kerner.